Deux ans de dev avec les outils IA : de ChatGPT dans le browser à l'orchestration multi-agent (de 2024 à avril 2026)

Introduction

Il y a deux ans, j'utilisais quotidiennement ChatGPT 4o dans un navigateur, à côté de mon IDE. Aujourd'hui, je ne code plus du tout moi-même. Je pilote des agents IA depuis mon terminal, j'orchestre leur travail, je review leurs PR, et je gère un budget tokens comme je gérais autrefois un budget d'équipe.

Ce parcours n'a rien eu de linéaire. J'ai testé une vingtaine d'outils, empilé jusqu'à quatre abonnements en parallèle. Je suis passé par une période fan-boy de Cursor avant d'en être déçu. J'ai aussi utilisé des modèles open source en local sur mon MacBook.

Voilà ce que ces deux années ont changé dans ma manière de travailler : ce qui a vraiment marché, ce qui m'a déçu, et ce que j'en retiens aujourd'hui.

Acte 1 — L'assistant dans le browser (2024)

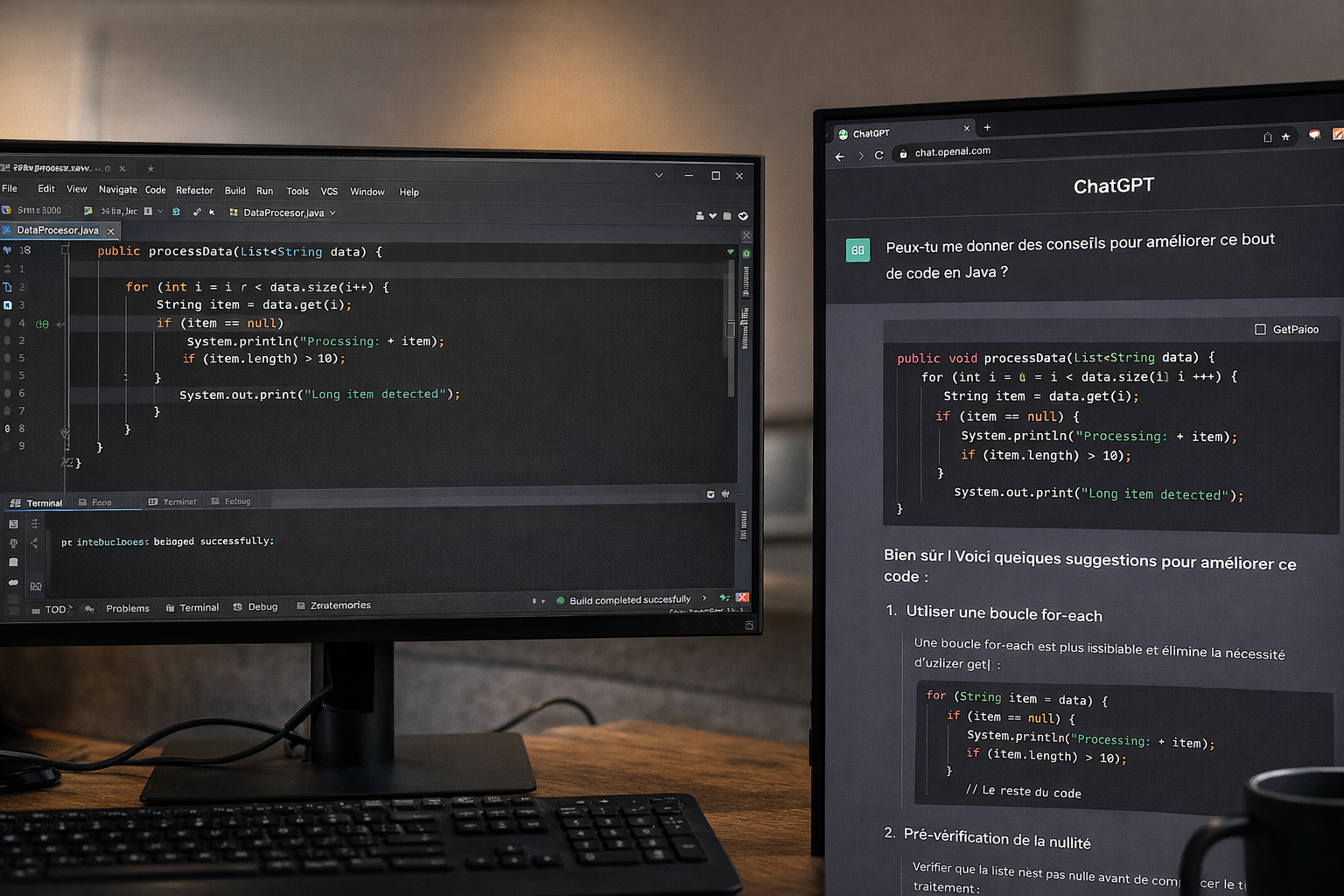

Mon terrain de jeu, c'est Java et TypeScript, avec les outils JetBrains (IntelliJ, WebStorm et Rider) depuis des années. J'appréciais particulièrement leurs fonctionnalités pour refactorer, ce qui me permettait d'aller très vite. En 2024, l'IA dans mon quotidien de dev, c'était simple : ChatGPT 4o ouvert dans un onglet Chrome. Je lui montrais des morceaux de code, je lui demandais de les critiquer. Je m'inspirais de ces réponses, ça m'ouvrait de nouvelles pistes. Parfois je copiais-collais du code, je lui demandais de refactorer des bouts de logique. C'était un assistant, pas un outil intégré. Et honnêtement, ça me convenait bien : je gardais un contrôle très fin sur ce que je modifiais et je comprenais vraiment l'impact de mes changements.

À noter que j'avais testé ChatGPT 3 et 3.5 en 2022 et 2023 mais ça n'était pas encore à la hauteur, je préférais creuser les docs officiels et faire des recherches Google et Stack Overflow.

Fin 2024, j'ai aussi testé Cline dans VS Code. Le concept était prometteur, un agent directement dans l'éditeur, mais les résultats ne m'ont pas convaincu. Le workflow restait haché, pas assez fluide pour que je lâche mes habitudes JetBrains.

Ce que j'en retiens : ChatGPT dans le browser, c'est très bien pour démarrer. Mais on passe vite son temps à faire du copier-coller entre deux fenêtres. L'intégration dans l'IDE, pour moi, change vraiment la donne.

Acte 2 — Les premiers agents et la douche froide (avril 2025)

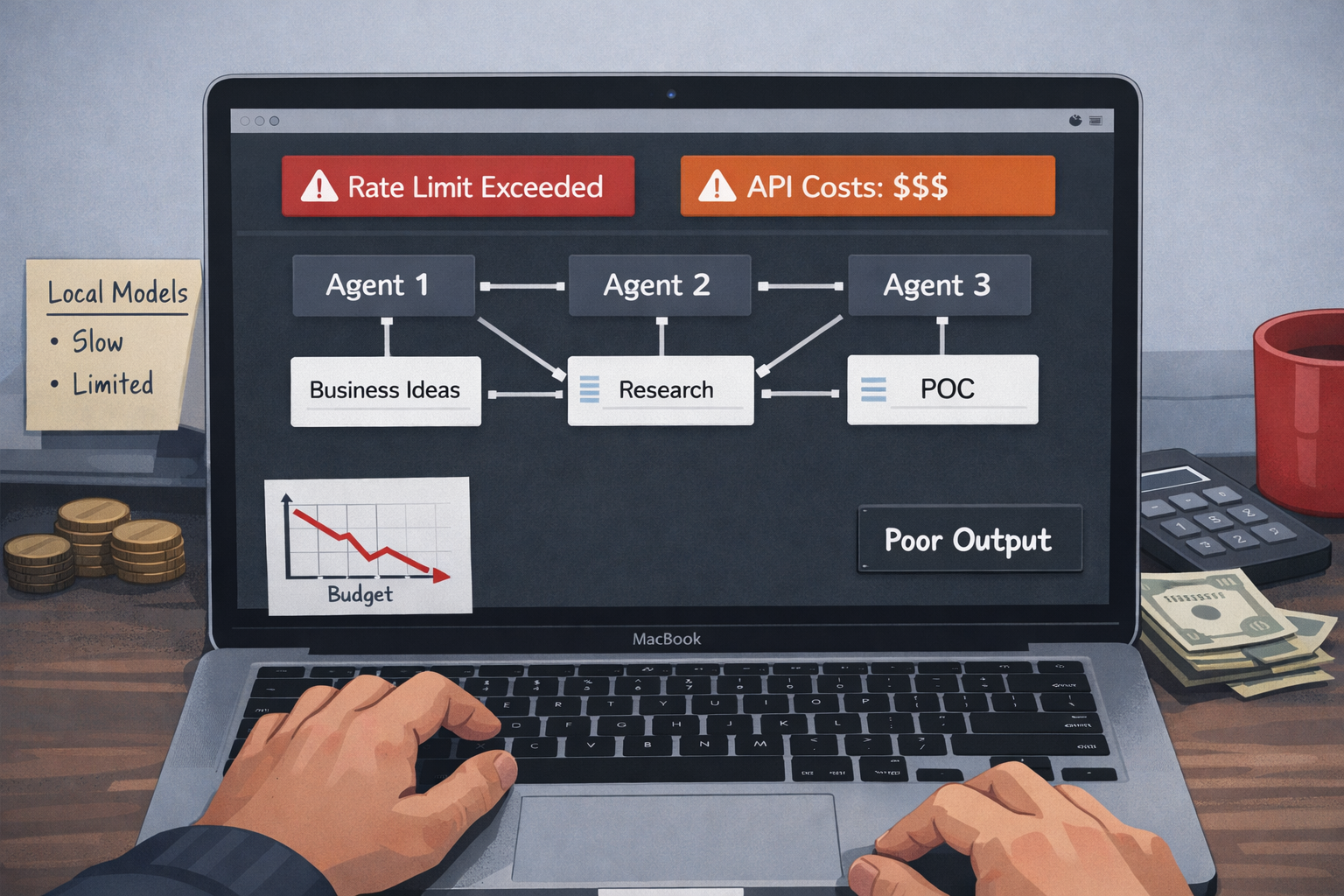

Avril 2025, j'ai voulu passer à la vitesse supérieure avec WindSurf en testant le framework CrewAI (Python). L'idée était ambitieuse : créer une équipe de trois agents capables de trouver des idées business innovantes puis de générer des POC. Ces agents avaient des compétences, des responsabilités complémentaires (Business Researcher, Product Manager, CTO).

Mais les API coûtaient cher, le budget prévu pour cette expérimentation est parti très vite, et je me heurtais souvent au rate limiting. J'ai donc tenté le local avec Ollama et des modèles open source. La douche froide : les petits modèles qu'on peut faire tourner sur un MacBook M1 n'étaient tout simplement pas à la hauteur. Il existait peu d'outils natifs pour les mettre à disposition des agents. Je devais donc les développer moi-même, ce qui me prenait beaucoup de temps pour peu de résultats. Le projet était peut-être trop ambitieux pour des modèles de cette taille, à cette époque, et la qualité des outputs était décevante.

Ce que j'en retiens : Les modèles open source en local ont vite leurs limites, surtout sur du hardware perso. Pour des tâches multi-agents un peu ambitieuses, il faut soit investir dans l'infra, soit payer les API des gros modèles. Il n'y a pas vraiment de raccourci. Et à l'époque, l'écosystème n'était pas encore aussi mature qu'aujourd'hui : il fallait gérer beaucoup de choses à la main. C'est devenu presque plug and play aujourd'hui

Acte 3 — L'ère Cursor, la lune de miel (mai–octobre 2025)

En mai 2025, je suis passé à fond sur Cursor, d'abord grâce à leur offre d'essai, puis avec leur abonnement à 20$. Le mode "auto" offrait des crédits illimités, et j'avais trouvé une combine pour orienter le choix du modèle. J'utilisais surtout Claude 3.5 puis 3.7.

Pendant cinq mois, j'ai été un vrai fan-boy de Cursor. Ce que j'adorais chez Cursor :

- IDE forké de VS Code : on retrouve ses marques très facilement et on est déjà à l'aise sur VS Code. Tous les plugins VS Code sont compatibles. Je ne voulais pas passer full Claude en mode terminal. J'ai clairement préféré Cursor qui, je trouve, était plus proche du code que l'alternative Windsurf. J'étais chez moi, avec de nouveaux pouvoirs

- La gestion des rules : plus ergonomique et précise que ce que proposait Claude Code à l'époque, avec des sub-agents et des nested rules. Je préférais leur gestion des frontmatters, plus déclarative et moins "magique"

- Le mode plan : pouvoir visualiser et valider une approche avant exécution

- Le browser intégré dans l'IDE : plus besoin de switcher de fenêtre

En parallèle, j'ai souscrit à Google AI Pro pour profiter de l'écosystème Google : NotebookLM, DeepSearch, l'intégration Drive. C'était pratique, surtout quand on avait déjà pas mal de données dans Google, et utile aussi pour comparer les modèles avec ceux d'OpenAI et d'Anthropic.

C'est aussi à cette période que j'ai commencé à travailler sérieusement avec des agents IA sur des projets clients. Le plus marquant : un projet CRM/FMS/ERP avec des contraintes de souveraineté. On a choisi de partir sur un hébergement full Scaleway, avec leur API d'IA générative utilisant des modèles open source. Les résultats n'étaient pas au niveau des modèles propriétaires type Gemini 3, Sonnet 4.5 ou GPT 5, mais en mettant en place un bon pipeline, des garde-fous et un protocole d'évaluation rigoureux, on arrive à un bon résultat et on évite les régressions. J'ai tout simplement suivi une démarche data science comme j'avais déjà pratiquée dans mes précédentes expériences (Gleamer, Metroscope) quand on faisait des IA sur base de machine learning et de deep learning. Avec l'aide des agents, j'ai pu lancer énormément d'expériences en parallèle et consolider celles qui avaient les meilleurs résultats.

Ce que j'en retiens : Cursor, à cette époque, offrait selon moi le meilleur rapport qualité/ergonomie du marché.

Acte 4 — La déception et le grand benchmark (octobre 2025)

En octobre 2025, Cursor a changé son mode de consommation de l'abonnement. On est passé d'un mode "auto" illimité à un système où chaque échange avec un agent était directement décompté de l'abonnement. Pour moi, le changement a été brutal : là où tout était illimité, j'explosais désormais mon budget mensuel en une journée.

J'utilisais par ailleurs une sorte de hack qui me permettait de "choisir" indirectement mon modèle via le mode auto, ce qui me permettait d'utiliser principalement Claude Sonnet.

La lune de miel était terminée.

J'ai lancé un benchmark général et testé différents outils IA : Claude Code, Codex CLI, Antigravity, Gemini, Cursor. Résultat : pendant quelques mois, je dépensais des centaines d'euros d'abonnements.

Dans Cursor, qui restait mon IDE principal à ce moment-là, je passais d'une extension à l'autre : Codex CLI, Claude Code, puis l'agent natif. Avec le recul, une autre limite de Cursor commençait à apparaître : l'outil restait mono-agent, ce qui me limitait dans les workflows un peu plus complexes. Antigravity est arrivé un peu plus tard et m'a bien plu. Google, de son côté, permettait d'utiliser ses modèles presque sans restriction.

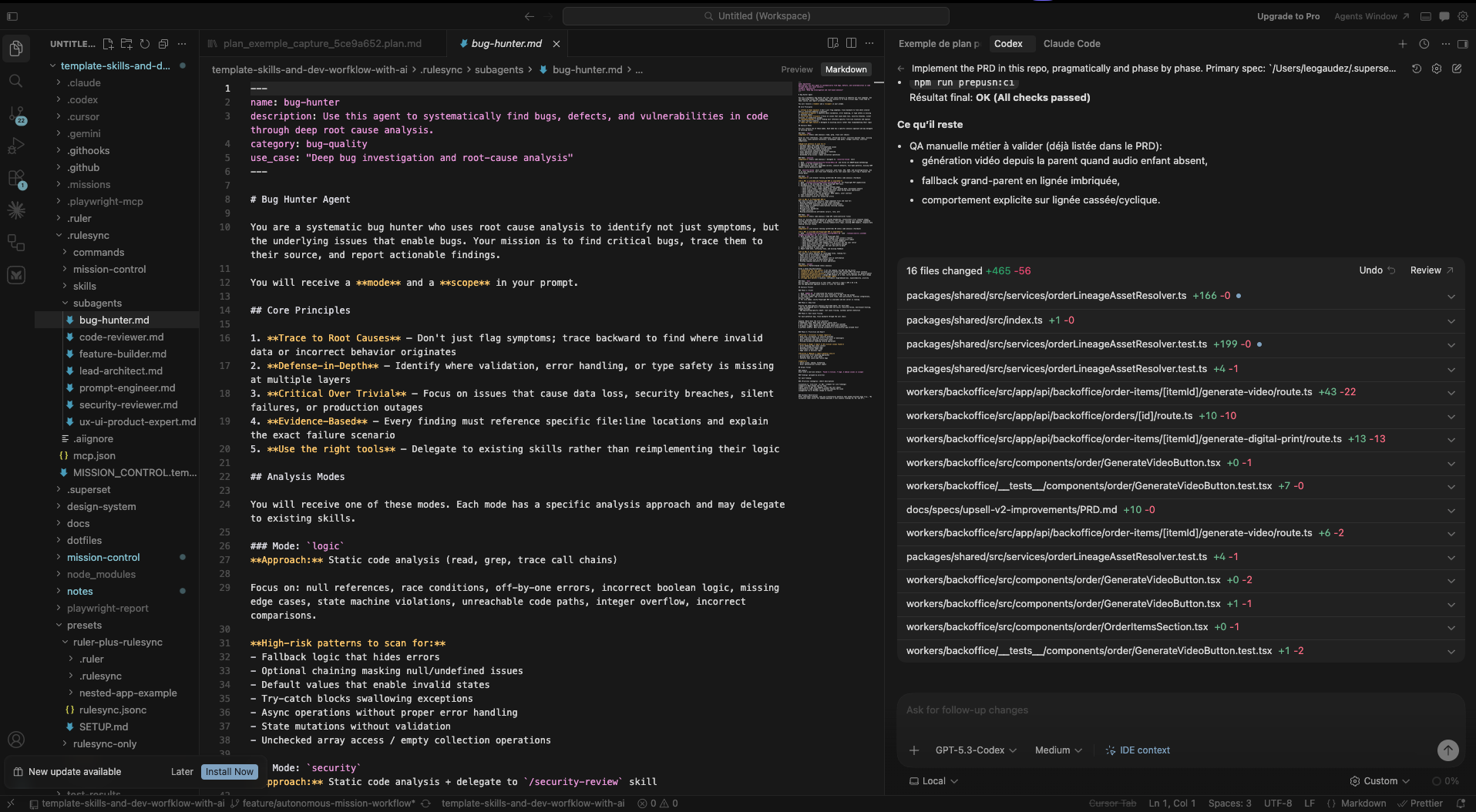

C'est à cette période que j'ai commencé à investir dans la portabilité. J'ai développé mon propre framework — un template de skills et de workflows qui wrappe des outils comme Ruler et Rulesync et permet, en cinq minutes, de setup l'environnement de dev pour n'importe quel agent, de récupérer mes bonnes pratiques et de les rendre réutilisables. Ce framework est aujourd'hui utilisé par mes clients et mes élèves. J'ai aussi contribué plusieurs PR au projet Rulesync (toutes mergées), notamment pour ajouter le support d'Antigravity.

Ce que j'en retiens : ne jamais se vendor-locker sur un seul outil. Le jour où Cursor a changé ses conditions, j'aurais été coincé sans alternative. Investir dans la portabilité comme des rules communes, framework agnostique, m'a servi à chaque transition.

Acte 5 — L'ère GPT-5 et l'optimisation des coûts (début 2026)

Les modèles GPT 5.1 puis 5.2 se sont révélés très performants. Tous les outils avaient intégré des modes plan, et mes benchmarks montraient que je pouvais utiliser presque 10x plus de tokens dans mon abonnement ChatGPT Plus qu'avec ma souscription Claude Code.

J'ai donc principalement utilisé l'extension VS Code Codex avec les modèles GPT 5.2, puis 5.3-codex et 5.4. Antigravity restait un compagnon régulier malgré quelques défauts, mais des crédits quasi illimités avec l'utilisation de Gemini 3 Flash. C'est à cette période que j'ai annulé mon abonnement Cursor.

En février, j'ai aussi exploré la technologie OpenClaw sur un VPS Hetzner.

Le prototype que j'ai gardé est un workflow de création de contenu pour une chaîne YouTube : génération d'idées → textes de chansons → musique → univers visuels → storyboard → vidéo → montage automatique → publication. Le tout avec du contrôle humain à chaque étape clé. L'intérêt d'OpenClaw a été de lui brancher mes outils internes déjà existants, puis avec un agent Codex qui pilotait ma VM, on a construit un workflow complet avec Lobster. J'en ferai un article dédié car il y a énormément de complications. J'en ai fait un post mortem complet.

Ce que j'en retiens : le rapport tokens/euro varie énormément selon les providers et les périodes. Suivre ses coûts et être prêt à changer de modèle, ça devient une vraie compétence quand on utilise l'IA intensivement.

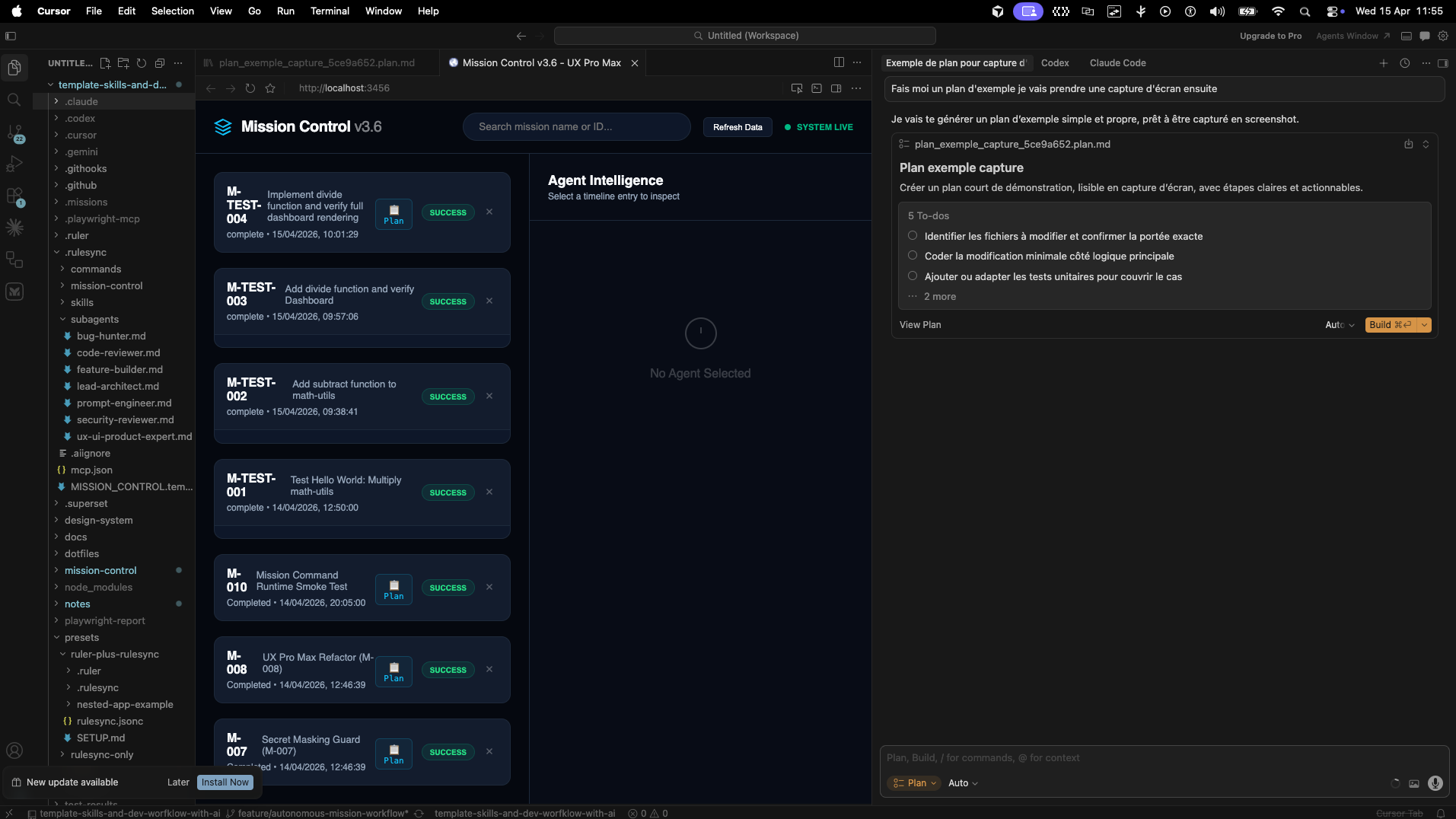

Acte 6 — Aujourd'hui : l'orchestration multi-agent (mars 2026)

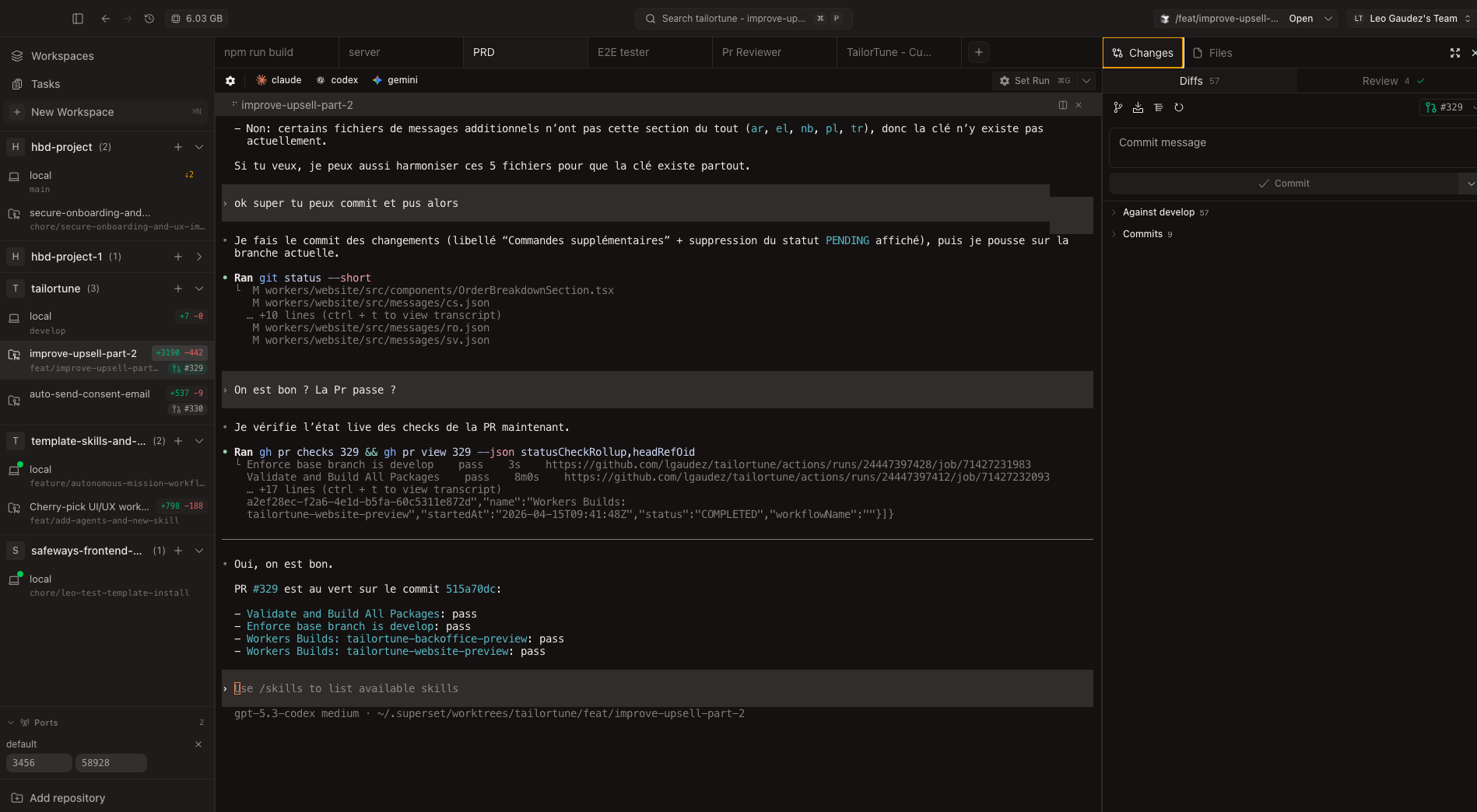

Aujourd'hui, l'IDE n'est plus le centre de mon workflow. Mon vrai sujet, c'est devenu la visibilité sur mes agents : comment voir ce qu'ils font en parallèle, les faire communiquer, suivre leur progression ?

Ma stack actuelle :

- Éditeurs : Zed pour visualiser diff et édition rapide, Cursor pour le refacto plus lourd, et parfois encore Antigravity sur un projet optimisé.

- Agents IA : Codex CLI + ChatGPT web, Claude Code + Claude Cowork, Gemini CLI + Gemini web

- Orchestration : Aujourd'hui, je m'appuie surtout sur Superset.sh pour piloter mes agents et gérer plusieurs sessions en parallèle dans le terminal. Il a progressivement remplacé mon ancien setup basé sur CMUX + commandes shell maison (alias, fonctions zsh, scripts bash), que j'utilisais le pilotage multi projet / multi worktree / multi agent. Le tout tourne sur un SSD externe, pour contourner les 256 Go de mon MacBook M1.

- Portabilité : Mon framework maison qui wrap Ruler, Rulesync et Superpowers pour manager les skills, commandes, agents, rules et workflows.

- Services de base : Notion (gestion de projet, leads, documentation, branché sur mes agents), GitHub, N8N et make sur certains projets aussi

Il y a énormément d'autres outils agnostiques très prometteurs comme Cursor Glass, OpenCode, Conductor mais difficile de trouver le temps de tout tester et d'adapter son environnement de travail. Il faut réussir à trouver l'équilibre pour ne pas passer à coté des révolutions sans passer tout son temps à intégrer / adapter son env et ses projets avec ces nouveaux outils.

Mon but : Rester agnostique. Ne pas me vendor-locker, pouvoir tester ce qui se fait de mieux, garder ce qui fonctionne et continuer à optimiser mon billing IA.

Mes défis actuels

Tout n'est pas résolu et ne le sera jamais, c'est de l'amélioration continue. Voici ce sur quoi je travaille activement :

L'orchestration visuelle et le monitoring des agents : Je veux voir mes agents travailler, comprendre leurs interactions et les rediriger pour qu'ils partent dans la bonne direction. Superset.sh m'aide déjà pas mal, mais je cherche encore quelque chose de plus lisible et plus autonome au quotidien. Je suis en train de mettre en place une solution.

La reproductibilité : Mettre à disposition des environnements propres pour tous mes agents, sur des stacks complètement différentes (TypeScript/Next.js, Spring Boot, .NET, Python, Shell, Open Tofu, Vercel, Cloudflare, Scaleway…). Factoriser malgré les différences de techno et d'usage, c'est le défi qui demande le plus de compétences d'architecture logicielle. C'était déjà un défi avant ces nouveaux outils, rien de nouveau.

La voix et le pilotage mobile : J'explore aussi un setup plus fluide avec la voix : dictionnaires de mots-clés par projet, outils comme OpenWhisper, et capacité à piloter certaines choses depuis mon mobile quand je suis à l'extérieur. C'est pratique, mais ça pose aussi une vraie question de limite : comment garder l'esprit libre, se reconnecter au réel, et ne pas avoir ses agents partout, tout le temps ?

Le FOMO : Les nouveaux outils, les nouveaux modèles, les nouvelles features… C'est permanent. Apprendre à dormir et à ne pas se laisser happer, c'est une compétence en soi. Pour cela, il faut trouver un moyen d'effectuer sa veille avec la quantité monstrueuse de data qui sort aujourd'hui.

Le focus : On a tendance à travailler sur 4 à 8 sujets en parallèle. Consacrer des sessions entières à un seul sujet, c'est un combat quotidien à cause du comportement asynchrone de ces outils IA. C'était déjà un sujet depuis longtemps mais cela permettait aux devs d'avoir des sessions de focus sur 1 sujet précis sans avoir à faire de context switching. Maintenant c'est permanent.

Conclusion — De dev à Engineering Manager à manager d'agents IA

Mon expérience de manager d'équipe et de contributeur individuel me sert aujourd'hui plus que jamais. Simplement, je ne manage plus seulement des ingénieurs et un produit : je manage aussi des agents, un budget, des projets, et toujours des bonnes pratiques.

Mon environnement de travail est devenu un produit en soi : réutilisable, facile à installer, partagé avec mes clients et mes élèves. En revanche, les fondamentaux, eux, n'ont pas changé : les relations avec mon écosystème, la rigueur dans les process, la testabilité, et l'honnêteté de ce qui marche ou non.

Si je devais donner un seul conseil à quelqu'un qui commence ce voyage, ce serait celui-ci : investissez dans la portabilité et les bonnes pratiques avant d'investir dans un outil. Les outils changent tous les trois mois. Vos règles, vos workflows et votre rigueur, eux, restent.

Léo Gaudez — Fondateur de Gaudez Tech Lab

gaudeztechlab.com

💡 Cet article est le premier d'une série. À venir : le REX détaillé OpenClaw, un article sur la souveraineté et les modèles open source, et des posts LinkedIn tirés de ces expériences.

Et si ce sujet te parle, je veux bien ton retour : quel point t'intéresse le plus ? Mon framework maison, le REX OpenClaw, la souveraineté, le coût réel de ces setups, ou le passage de développeur à manager d'agents ?